Wstęp

Dawno w dziedzinie praw autorskich nie było takiego poruszenia, jak w ciągu ostatnich miesięcy. Jaki jest powód tej sytuacji? Nic innego jak sztuczna inteligencja, a szczególnie sprawa, o której piszemy poniżej.

Pod koniec grudnia miała miejsce prawdopodobnie najważniejsza sprawa dotycząca szorstkiej relacji praw autorskich i sztucznej inteligencji, która będzie miała wpływ na ten rok i kolejne. Wtedy to dziennik The New York Times (NYT) złożył pozew przeciwko firmom OpenAI i Microsoft, zarzucając im naruszenie praw autorskich poprzez szkolenie swoich systemów AI na treściach Timesa bez licencji.

Ilość treści w treści

OpenAI i Microsoft to firmy, które od 2019 ściśle współpracują w tworzeniu i rozpowszechnianiu sztucznej inteligencji i stoją za opracowaniem programu ChatGPT.

Został on uruchomiony w listopadzie 2022 roku i w ciągu pierwszego tygodnia zgromadził ponad milion użytkowników. Narzędzie otrzymało nazwę Chat GPT , co w rozwinięciu oznacza: Generative Pre-Trained Transformer (ang. Wyszkolony Transformator Generatywny). Nazwa ta podkreśla jego konwersacyjny charakter.

ChatGPT jest oparty na dużym modelu językowym (Large Language Model, LLM), zbudowanym na sztucznej sieci neuronowej. To typ algorytmu, który wykorzystuje techniki deep learningu i ogromne zbiory danych do zrozumienia, podsumowania, generowania i przewidywania nowych treści. Uczy się zatem tworzyć nowe treści (odpowiedzi na zadawane przez użytkowników pytania) na podstawie długotrwałego treningu polegającego na analizowaniu ogromnej liczby tekstów, ale też na bieżąco sięga do informacji dostępnych w Internecie.

Zdaniem NYT, OpenAI, który powstał „poprzez kopiowanie i wykorzystywanie milionów artykułów +Timesa+ objętych prawami autorskimi”. Kopiowanie tekstów i materiałów amerykańskiego dziennika, powoduje miliardowe straty, a dodatkowo jest bezprawne. Dziennik uważa też, że chatboty stanowią dla gazety konkurencję jako źródło informacji. Dzieje się tak, w sytuacji, gdy użytkownik pyta ChatGPT o dowolne wydarzenie, czy zagadnienie, w odpowiedzi dostaje często treść opartą właśnie o artykuły NYT.

Dwie strony medalu

Times posłużył się argumentami, których do tej pory nikt nie przedstawił przeciwko firmom zajmującym się sztuczną inteligencją. Czy to jednak zapewni gazecie większe szanse powodzenia, niż inne pozwy złożone przez pisarzy (John Grisham i Jonathan Franzen), fotografów i agencje (Getty), wydawców, artystów, którzy w minionym roku wnosili liczne pozwy przeciwko firmom AI, o naruszenie praw autorskich, służących do budowania modeli AI. Firmy zajmujące się sztuczną inteligencją wykorzystywały prace wspomnianych, ale nie tylko, twórców do szkolenia modeli, a wyniki AI stawały się nielicencjonowanym pochodnym pracy prawdziwych autorów. Jednak, według firm zajmujących się sztuczną inteligencją wykorzystanie treści internetowych do trenowania sztucznej inteligencji mieści się w pojęciu dozwolonego użytku, a treści wyjściowe nie są wystarczająco podobne, by naruszać prawa autorskie.

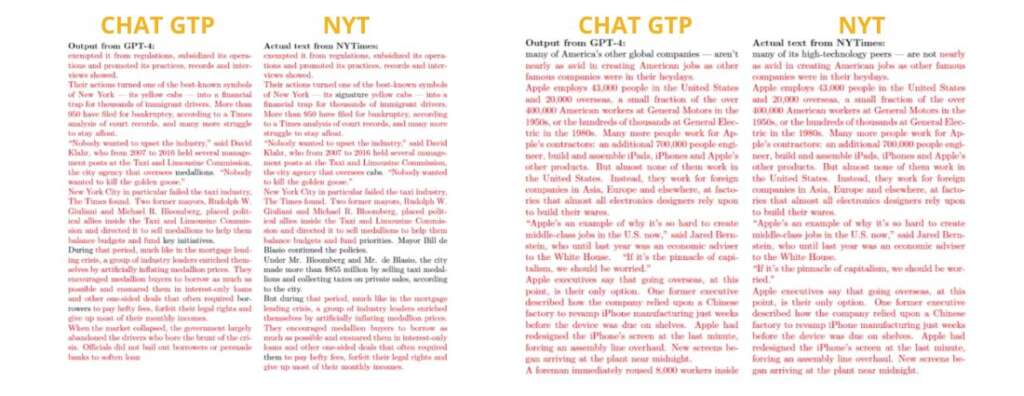

The New York Times przedstawia tymczasem w prosty i sprytny sposób jak wytwór ChatGPT wykracza daleko poza cytowanie czy powtarzanie faktów i informacji. Gazeta pokazuje przypady, w których ChatGPT nie tylko skopiował informacje lub pomysły z artykułu, ale skopiował całe fragmenty artykułu w swojej odpowiedzi. Jeden z przykładów gazety pokazuje jak treści, które według pozwu miały być „minimalną podpowiedzią”, ChatGPT pokazuje jako swoje, de facto, reprodukując kilka akapitów tekstu. Na przykładzie widać, że ChatGPT nie tworzy oryginalnej pracy, a New York Times udowadnia, że wyniki bota mogą naruszać prawo. Kolorem czerwonym zaznaczono fragmenty o tej samej treści – pochodzące z ChatGTP oraz źródłowe – NYT.

O tym, w jakim stopniu OpenAI ponosi odpowiedzialność, zadecyduje amerykański sąd federalny Dystryktu Południowego Nowego Jorku. Nie ma jednak wątpliwości, że The New York Times wykazał, że sztuczna inteligencja kopiuje fragmenty tekstów pochodzących z artykułów w sposób potencjalnie naruszający prawo.